2月16日,OpenAI推出了一款革新性的AI视频生成工具——Sora,该工具以日语中的“天空”命名,象征着无限的创造力。尽管市场上已有如Runway的Gen-1和Gen-2、Google的Imagen Video和Phenaki,以及Meta的Make A Video等类似的文字或图像转视频工具,但Sora在视频生成技术和连贯性方面取得了显著突破。

传统的AI视频生成工具通常采取逐帧生成图片的方式,然后将这些图片连续播放以形成视频。然而,这种方法的局限性在于,尽管各帧图片可能围绕同一关键词生成,但生成的结果往往大相径庭,导致视频在过长时会出现人物形象变化或其他不连贯问题。

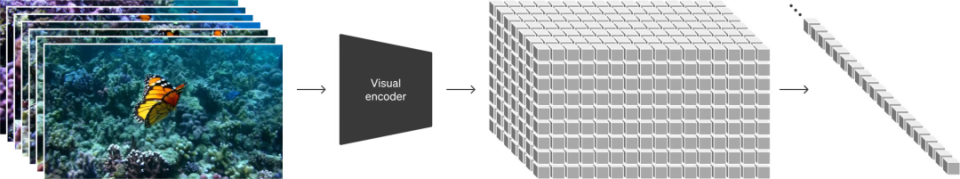

Sora则采用了独特的“空间时间补丁”技术。根据OpenAI发布的技术文件和专家的解读,Sora在接收到文字指令后,能够将预定视频切割为多个带有空间和时间信息的小片段,并分别进行生成。这一创新方法不仅提高了视频的生成效率,还确保了视频在长度和连贯性上的卓越表现。

Sora的发布标志着AI视频生成技术进入了一个新的里程碑,它将为创作者和开发者提供更强大、更灵活的视频生成工具,推动AI在视频制作领域的广泛应用。

OpenAI技术文件中展示的“空间时间补丁”技术示意图,为Sora赋予了前所未有的精细控制能力,确保了视频内容的前后一致,并极大地丰富了视频细节。在Sora发布的模拟视频中,这种连贯性所带来的优势显而易见,包括更加逼真的人物与环境互动模拟、视频的灵活扩展,以及将多个视频无缝融合为一个连贯的整体等。

不仅如此,Sora在物理建模和构图方面的表现也显著超越了以往的工具。与那些将输入图像统一裁剪为固定格式的传统工具不同,Sora能够直接按照原始图像的比例和分辨率生成视频,这意味着它能够更加精准地捕捉视频的核心内容,并以更加自然的角度模拟同一物体的不同动作。这一突破性的技术将为视频制作带来全新的可能性,开启AI视频生成的新篇章。

OpenAI最新发布的示范视频截图展示了其强大的能力,指令要求“镜头穿越繁忙的东京城市街道,捕捉美丽的雪景,同时跟随几个人在雪天享受购物乐趣,周围樱花花瓣与雪花随风飘舞”。然而,尽管外界对其赞誉有加,关于Sora的许多细节仍然笼罩在神秘之中。

目前,Sora的使用权限仅限于一小部分“视觉艺术家、设计师和电影制作人”以及特定的安全测试人员。关于其语言支持的范围和公开时间,OpenAI尚未给出明确答案。技术文件中仅简要介绍了Sora的技术原理,包括使用GPT、DALLE-3等前代技术进行文本分析,但并未像GPT-3那样公开训练集和模型结构。

有专家猜测,Sora可能运用了纽约大学教授谢赛宁及其团队开发的技术模型,还有观点认为其采用了虚幻引擎5来创建部分训练数据。然而,OpenAI对于系统学习了多少视频以及视频来源等关键问题保持沉默,仅表示培训数据包括公开视频和获得版权许可的视频。

这种保密措施似乎已成为大型科技公司发布新模型版本的标准做法。在Sora发布的同时,Google也推出了其Gemini 1.5升级版本,同样仅供少数开发者和企业客户预览。斯坦福大学基础模型研究中心对十大主要AI模型的分析显示,这些模型开发商普遍缺乏透明度。

OpenAI对于暂不发布工具和更多细节的解释是,他们仍在努力减少生成视频中的错误信息、仇恨内容和偏见,并为所有生成的视频添加了水印。然而,这些水印同样可以被移除。考虑到短视频在政治和社会方面的巨大影响力,人工智能领域所面临的监管压力正前所未有的高涨。

如有侵权,请联系删除。